Nous aborderons avec ce chapitre 4 sur les lois des grands nombres des notions plus théoriques que pratiques. Mais pourtant, il nous est indispensable de commencer par les convergences de variables. En effet, ces théorèmes des grands nombres nous servirons pour les estimateurs, intervalles de confiance ou encore en régression linéaire.

Puisqu’il nous faut étudier les théorèmes de convergence, mettons à nouveau de côté nos divergences avec les mathématiques. Car comme nous allons le découvrir, la loi des grands nombres est particulièrement utile en biologie. Nous en profiterons donc pour aborder les différences entre loi faible et loi forte (rien de darwinien là-dedans) et citer de nouveau le fameux théorème central limite. Alors, en route vers la convergence des chemins statistiques !

5. La convergence de variables

5.1. Formulaire des épreuves répétées

La convergence est une notion importante en statistiques, puisqu’elle rentre en compte dans l’étude des lois de probabilités. Elle nous permet de considérer, par exemple, que la moyenne de n variables aléatoires indépendantes converge vers une espérance E commune. Les théorèmes de convergences se basent ainsi sur des sommes et produits de variables aléatoires et permettent d’établir les formules fondamentales de ce qu’un mathématicien qualifierait de théorie des épreuves répétées.

Or, en sciences expérimentales, répéter toujours et sans cesse la même épreuve sous forme d’observations ou d’expérimentations, voilà bien notre tâche quotidienne ! Comme nous l’avons déjà vu précédemment, nous pouvons considérer l’acquisition de nos données comme une série d’épreuves répétées de variables aléatoires indépendantes entre-elles.

Pour une suite de n variables aléatoires, nous définissons la somme Sn et la moyenne X̅n comme deux nouvelles variables aléatoires :

Sn = X1 + X2 + X3 + … Xn

X̅n = Sn / n

Nous pouvons également regrouper les formules de l’espérance, de la variance et de l’écart-type de ces deux nouvelles variables aléatoires dans un tableau :

| Somme Sn | Moyenne X̅n |

|---|---|

| E(Sn) = n.µ | E(X̅n) = µ |

| Var(Sn) = n.σ² | Var(X̅n) = σ²/n |

| σ(Sn) = σ.√n | σ(X̅n) = σ/√n |

Ces formules servent notamment pour la loi binomiale ainsi que pour les estimateurs en statistiques.

5.2. La Loi des Grands Nombres (LGN)

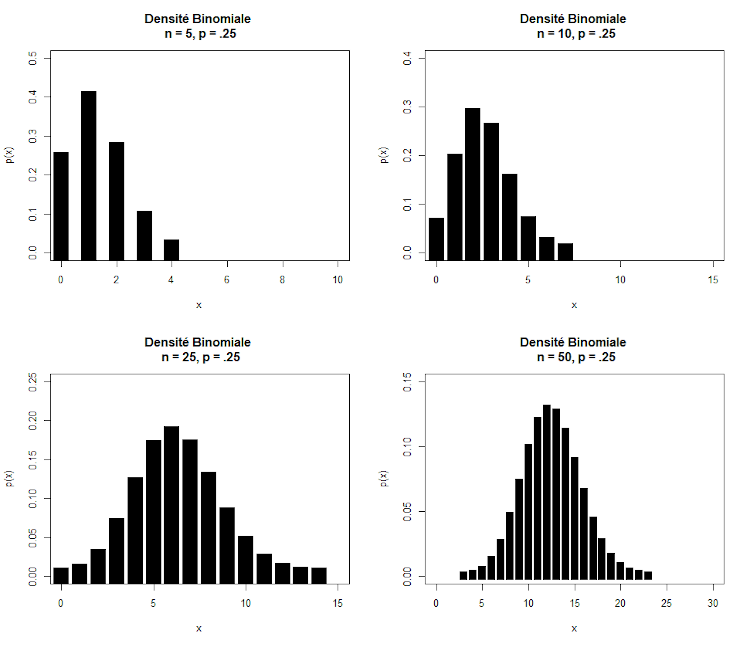

En mathématiques, la loi des grands nombres permet d’interpréter la probabilité comme une fréquence de réalisation. En d’autres termes, elle signifie que la moyenne empirique, calculée sur les valeurs d’un échantillon, converge vers l’espérance lorsque la taille de l’échantillon tend vers l’infini (n → ∞).

La loi des grands nombres est donc particulièrement utile en biologie dès lors que nous essayons de travailler avec des échantillons les plus grands possibles ! Elle se subdivise elle-même en deux catégories :

- La loi faible des grands nombres met en évidence une convergence traduite en calcul de probabilité.

- La loi forte des grands nombres donne une convergence presque sûre de se réaliser.

5.3. Lois faibles des Grands Nombres

5.3.1. Inégalité de Bienaymé-Tchebychev

Plus l’écart-type d’une variable est faible, plus sa distribution de probabilité se concentre autour de son espérance mathématique. Par ce postulat, il est possible de calculer la probabilité qu’une variable aléatoire soit incluse dans un intervalle de confiance.

L’équation de l’inégalité de Bienaymé-Tchebychev prend en compte un facteur k, dépendant de l’écart-type σ selon la relation k = a/σ. La probabilité que cet intervalle de confiance soit vérifié est alors supérieure ou égale à 1 – 1/k² :

P[E(X) – k.σ ≤ X ≤ E(X) + k.σ ] ≥ 1 – 1/(k²)

Dans la pratique, cette inégalité nécessite peu d’informations pour être calculée. Il nous faut uniquement l’espérance E et la variance σ² de la variable aléatoire X. Nous fixerons ensuite une valeur a pour vérifier l’affirmation suivante : la probabilité que X s’éloigne d’une valeur > a de son espérance E est plus petite que la valeur σ²/a² .

Notez que cette formule n’a nul besoin de taille d’échantillon ou de population. Elle peut donc permettre d’estimer des intervalles avant même de réaliser l’expérience, pour peu que nous ayons les données précédemment citées ! Mais elle est peu précise, et on lui préfère le théorème central limite pour déterminer des intervalles de confiance.

Par exemple, la sardine (Sardina pilchardus) atteint 16,9 cm en moyenne à maturité sexuelle (σ² = 0,05). Calculons la probabilité que X soit compris entre 16,5 cm et 17,3 cm.

P[16,5 ≤ X ≤ 17,3] équivaut à E-k.σ = 16,5 soit k = (16,9-16,5)/0,23 = 1,73 ; 1-1/k² = 0,67. Donc la probabilité pour que cet intervalle soit rencontré dans une population de sardines adultes est supérieure à 67 %.

5.3.1. Théorème des grands nombres

Pour une suite de variables aléatoires, de même espérance mathématique µ et de même variance σ² , nous appliquons les transformations de somme Sn et de moyenne X̅n = Sn/n. Alors tout écart à la moyenne ϵ tel que X̅n – µ = ϵ se voit attribuer une probabilité P(|X̅n – µ| ≥ ϵ).

La probabilité P que la valeur absolue |X̅n – µ| soit supérieure à cet écart ϵ , et donc que pour cet écart toléré la variable aléatoire de la moyenne ne tende plus vers l’espérance µ , P tend vers 0 lorsque n tend vers l’infini. Soit en d’autres termes :

P(|X̅n – µ| ≥ ϵ) = 0 si n → ∞

Le théorème des grands nombres nous indique qu’il y a convergence en probabilité. Cela signifie qu’il est toujours probable qu’un écart ϵ soit dépassé pour de grandes valeurs de n. Mais plus l’échantillon est grand, plus ce risque s’amenuise.

5.3.2. Théorème Central Limite

Supposons tout d’abord que nous ayons à traiter n variables aléatoires : X1, X2, X3, … Xn. Elles sont indépendantes 2 à 2, distribuées selon la même densité de probabilité et possèdent toutes les mêmes moyenne et variance.

Alors, on pose Sn = X1+ X2+ X3+ … + Xn de sorte que :

Alors Z tend vers une loi normale centrée réduite lorsque n tend vers l’infini. Si l’on formule la fonction de répartition de Zn , on obtient la formule suivante :

Qui est certes très jolie mais peu parlante ! En fait, il s’agit d’une fonction de loi normale centrée réduite N(0;1) pour n → ∞

5.2. Lois fortes des grands nombres

Dans la loi forte des grands nombres, Si les variables Xn sont considérées comme indépendantes, de même loi, et si E(|X|) < + ![]() , alors la probabilité suivante est vérifiée :

, alors la probabilité suivante est vérifiée :

Ce qui signifie qu’il n’y a aucune chance pour que X̅n ne soit pas égal à µ ! C’est pourquoi on distingue les lois faibles des lois fortes. Les premières raisonnent toujours en probabilités, les secondes considèrent notre égalité entre moyenne empirique et espérance comme acquise. Mais dans ce second cas, comment calculer des intervalles de confiance ? C’est pourquoi nous raisonnerons dans le cadre de notre approche biostatistique uniquement avec les lois faibles.

Quelle est la suite ? Dans l’épisode VI, les instituts de sondages contre-attaquent ! Nous aborderons les intervalles de confiance en statistiques et nous demanderons si nous pouvons avoir foi en nos résultats expérimentaux.