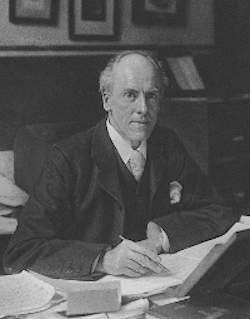

Le test du χ² est probablement le plus célèbre des tous les tests d’hypothèse en statistique interférentielle. Sa genèse joue un rôle majeur dans l’histoire des sciences. En 1900, le statisticien Karl Pearson publia dans la revue Philosophical magazine un article désormais considéré comme fondateur des statistiques modernes. De ces travaux découlent le fameux test du khi-deux, aussi écrit test du χ² . Pearson reçut la médaille Darwin en 1898. Un prix de statistiques porte désormais son nom. Il fut également le co-fondateur de la biométrie. Hélas, ses travaux se basaient sur l’eugénisme raciste de l’époque victorienne. Chose assez méconnue, les eugénistes anglais de cette période contribuèrent grandement à l’essor des biostatistiques modernes.

Il existe ainsi deux tests du khi-deux. Le premier fait intervenir une seule distribution. Le second compare plusieurs distributions. Heureusement dans l’ensemble leur mise en œuvre est assez semblable. Dans cet article, je vous propose de revenir sur les tests khi-deux d’ajustement et d’indépendance.

1. Test khi-deux d’ajustement

Le but du test d’ajustement est de comparer globalement la distribution observée à la distribution théorique. Un risque d’erreur α est associé. Soit une distribution à laquelle est associée un ensemble fini de probabilités.

1.1. Principe du test

Pour une loi binomiale de probabilité p et 1-p , nous comparons k classes théoriques équiprobables, et d’autre part un échantillon de taille n dont nous connaissons les effectifs observés.

L’hypothèse H0 de conformité postule que pour chaque classe, l’égalité de probabilité théorique avec la probabilité réelle est vérifiée. Pour plus de facilités, un tableau de données peut reprendre les fréquences des différents tirages de l’échantillon n de valeurs Np^j par rapport aux probabilités de classes théoriques k de valeurs Npj.

L’écart à tester désigné par la lettre T se formule de la manière suivante :

L’écart critique Tα se lit dans la table de la loi du χ² avec d.d.l. = k-2 . Si T < Tα l’hypothèse H0 est vérifiée.

1.2. Mise en application sous R

Il suffit pour cela d’utiliser la commande chisq.test() comme ci-dessous. Par exemple, pour un test d’ajustement entre deux caractères génétiques de forme de nageoire caudale chez des poissons. A et B; les fréquences alléliques sont %(A) = 30 % et %(B) = 70%. Sur un échantillon de 100 poissons prélevés, n(A) = 45 et n(B) = 55. Le logiciel R indique quant à lui une p-valeur d’interprétation du test.

genetique <- c(0.3,0.7)

poissons <- c(45,55)

chisq.test(poissons,p=genetique)

#Chi-squared test for given probabilities

data: poissons

X-squared = 10.714, df = 1, p-value = 0.001063

2. Test χ² d’indépendance

Nous comparons alors deux variables aléatoires, numériques ou qualitatives, définis sur une même population. Chaque caractère va donc concerner une sous-population. Le test χ² d’indépendance va permettre de tester la liaison entre ces deux variables aléatoires en établissant une modalité commune.

2.1. Principe du test

Les données expérimentales sont ainsi croisées dans un tableau de contingence. Par exemple, nous suivons l’effet de deux traitements expérimentaux contre le coronavirus sur deux groupes distincts de patients. Au bout de 5 jours, l’équipe médicale note l’état du patient selon deux modalités : « guéri » et « non-guéri » . Il s’agit bien de deux variables aléatoires nominales (« état du patient » et « type de traitement »). Les fréquences des modalités prises par la variable « état du patient » observées chez les nA patients ayant reçu le traitement TA vont être confrontées à celles observées chez les nB patients ayant reçu le traitement TB.

L’hypothèse H0 consiste alors à considérer que les deux variables aléatoires sont indépendantes. Il s’agit en d’autres termes de l’homogénéité des sous-populations par rapport au seul caractère explicité. Dans l’exemple précédent, H0 correspond à l’hypothèse : « la guérison au bout de 5 jours n’est pas liée au type de traitement suivi » (hypothèse d’indépendance). A l’inverse, l’hypothèse H1 considère que les deux variables aléatoires sont liées (hypothèse de dépendance) : « la guérison au bout de 5 jours dépend du type de traitement suivi » .

Le calcul de l’écart à tester correspond à la formule suivante :

L’écart critique se lit sur la table de la loi du χ² avec le d.d.l. = (L-1).(C-1) où L et C sont les nombres de lignes et de colonnes du tableau de contingence.

Attention cependant, le test χ² d’indépendance ne permet pas de juger de l’importance relative des deux variables aléatoires comparées. Par exemple, il ne dira pas l’efficacité relative de chaque traitement, mais uniquement s’il existe ou non un effet sur la guérison. Pour obtenir ces informations, il faudrait utiliser un test sur les proportions.

2.2. Mise en application

Les tests d’indépendance sont particulièrement utiles en sciences médicales. Je vous propose, pour plus d’explications, de découvrir l’excellente vidéo de Pascal Rigolet :

Sous le logiciel R, pour un test χ² d’indépendance, il conviendra de rentrer son tableau de données sous forme d’une matrice avec la fonction matrix() . Prenons l’exemple suivant d’un jeu de données des tailles d’un échantillon d’hommes et de femmes :

hommes = c(184,191,175,195,200)

femmes = c(165,170,180,168,171)

table = matrix(c(hommes, femmes),2,5,byrow=T)

khi_test = chisq.test(table)

khi_test

#Pearson's Chi-squared test

data: table

X-squared = 2.0035, df = 4, p-value = 0.7351

Dans cet exemple, le khi-carré calculé est inférieur au khi-carré théorique. Cela peut se vérifier avec une table du khi-carré. Nous pouvons donc en conclure que les deux variables sont indépendantes. L’hypothèse H0 « les deux séries de tailles chez les hommes et les femmes ne sont pas liées ente-elles » est donc acceptée.

Nous nous interrogeons ensuite si les effectifs d’élèves inscrits dans une licence d’informatique reflètent une différence de sexe notoire.

hommes = c(56,78,80,54,200,123,156)

femmes = c(14,5,12,10,71,26,33)

table = matrix(c(hommes, femmes),2,7,byrow=T)

khi_test = chisq.test(table)

khi_test

#Pearson's Chi-squared test

data: table

X-squared = 21.615, df = 6, p-value = 0.001422

Sur ce second exemple, l’hypothèse H0 « les sexes des élèves sont indépendants dans les effectifs de cette licence pour chaque rentrée universitaire « est rejetée car le khi-carré calculé est supérieur au khi-carré théorique. La probabilité de se tromper est extrêmement faible ! L’hypothèse H1 « les filles sont moins représentées en licence d’informatique que les garçons » se vérifie ici.